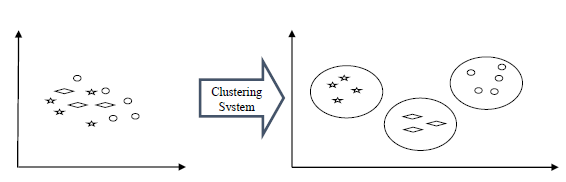

Методы кластеризации являются одним из наиболее полезных неконтролируемых методов ML. Эти методы используются для нахождения сходства, а также моделей взаимосвязи между выборками данных, а затем группируют эти выборки в группы, имеющие сходство на основе признаков.

Кластеризация важна, потому что она определяет внутреннюю группировку среди текущих немеченых данных. Они в основном делают некоторые предположения о точках данных, чтобы составить их сходство. Каждое предположение будет создавать разные, но одинаково действительные кластеры.

Например, ниже приведена схема, на которой показана кластерная система, сгруппированная в один и тот же тип данных в разных кластерах.

Методы формирования кластеров

Нет необходимости, чтобы кластеры формировались в сферической форме. Ниже приведены некоторые другие методы формирования кластеров —

Плотность на основе

В этих методах кластеры образуются в виде плотной области. Преимущество этих методов заключается в том, что они имеют хорошую точность, а также хорошую способность объединять два кластера. Ex. Основанная на плотности пространственная кластеризация приложений с шумом (DBSCAN), точек упорядочения для определения структуры кластеризации (OPTICS) и т. Д.

Иерархическая основе

В этих методах кластеры формируются в виде древовидной структуры на основе иерархии. У них есть две категории, а именно: агломерация (подход «снизу вверх») и дивизия (подход «сверху вниз»). Ex. Кластеризация с использованием представителей (CURE), Сбалансированная итеративная редукционная кластеризация с использованием иерархий (BIRCH) и т. Д.

Разметка

В этих методах кластеры формируются путем разбиения объектов на k кластеров. Количество кластеров будет равно количеству разделов. Ex. K-означает, кластеризация больших приложений на основе рандомизированного поиска (CLARANS).

сетка

В этих методах кластеры формируются как сетчатая структура. Преимущество этих методов заключается в том, что все операции кластеризации, выполняемые в этих сетках, выполняются быстро и не зависят от количества объектов данных. Ex. Статистическая информационная сетка (STING), кластеризация в квесте (CLIQUE).

Измерение производительности кластеризации

Одним из наиболее важных соображений, касающихся модели ML, является оценка ее характеристик, или, можно сказать, качество модели. В случае контролируемых алгоритмов обучения оценить качество нашей модели легко, потому что у нас уже есть ярлыки для каждого примера.

С другой стороны, в случае неконтролируемых алгоритмов обучения мы не так счастливы, потому что имеем дело с немаркированными данными. Но все же у нас есть некоторые метрики, которые дают практикующему специалисту представление о происходящих изменениях в кластерах в зависимости от алгоритма.

Прежде чем мы углубимся в такие метрики, мы должны понять, что эти метрики только оценивают сравнительные характеристики моделей друг против друга, а не измеряют достоверность прогноза модели. Ниже приведены некоторые из метрик, которые мы можем использовать в алгоритмах кластеризации для измерения качества модели.

Анализ силуэта

Анализ силуэта используется для проверки качества кластерной модели путем измерения расстояния между кластерами. По сути, это дает нам возможность оценить параметры, такие как количество кластеров, с помощью показателя Silhouette . Эта оценка показывает, насколько близко каждая точка в одном кластере к точкам в соседних кластерах.

Анализ силуэта баллов

-

Анализ баллов силуэта — диапазон баллов силуэта [-1, 1].

Анализ баллов силуэта — диапазон баллов силуэта [-1, 1].

Типы алгоритмов кластеризации ML

Ниже приведены наиболее важные и полезные алгоритмы кластеризации ML.

K-означает кластеризацию

Этот алгоритм кластеризации вычисляет центроиды и выполняет итерации, пока мы не найдем оптимальный центроид. Предполагается, что количество кластеров уже известно. Это также называется алгоритм плоской кластеризации . Количество кластеров, идентифицированных по данным алгоритмом, обозначается буквой «K» в K-средних.

Алгоритм среднего смещения

Это еще один мощный алгоритм кластеризации, используемый в обучении без учителя. В отличие от кластеризации K-средних, она не делает никаких предположений, следовательно, это непараметрический алгоритм.

Иерархическая кластеризация

Это еще один неконтролируемый алгоритм обучения, который используется для группировки немаркированных точек данных, имеющих сходные характеристики.

Мы будем подробно обсуждать все эти алгоритмы в следующих главах.

Приложения кластеризации

Мы можем найти кластеризацию полезной в следующих областях:

Суммирование и сжатие данных. Кластеризация широко используется в областях, где нам требуется также суммирование, сжатие и сокращение данных. Примерами являются обработка изображений и векторное квантование.

Системы совместной работы и сегментация клиентов. Поскольку кластеризацию можно использовать для поиска аналогичных продуктов или пользователей того же типа, ее можно использовать в области систем совместной работы и сегментации клиентов.

Служить в качестве ключевого промежуточного шага для других задач интеллектуального анализа данных — кластерный анализ может генерировать компактную сводку данных для классификации, тестирования, генерации гипотез; следовательно, он служит ключевым промежуточным этапом и для других задач интеллектуального анализа данных.

Обнаружение трендов в динамических данных. Кластеризация также может использоваться для обнаружения трендов в динамических данных путем создания различных кластеров схожих трендов.

Анализ социальных сетей — кластеризация может использоваться в анализе социальных сетей. Примеры генерируют последовательности в изображениях, видео или аудио.

Анализ биологических данных — кластеризация также может использоваться для создания кластеров изображений, видео, следовательно, она может успешно использоваться для анализа биологических данных.