Обработка естественного языка — Введение

Язык — это способ общения, с помощью которого мы можем говорить, читать и писать. Например, мы думаем, мы принимаем решения, планы и многое другое на естественном языке; точно, на словах. Однако, большой вопрос, который стоит перед нами в эту эпоху ИИ, заключается в том, можем ли мы так же общаться с компьютерами. Другими словами, могут ли люди общаться с компьютерами на их естественном языке? Для нас непросто разрабатывать приложения НЛП, поскольку компьютерам нужны структурированные данные, но человеческая речь неструктурирована и часто неоднозначна по своей природе.

В этом смысле мы можем сказать, что обработка естественного языка (NLP) — это подразделение компьютерных наук, особенно искусственного интеллекта (ИИ), которое занимается предоставлением компьютерам возможности понимать и обрабатывать человеческий язык. Технически, основной задачей НЛП было бы программирование компьютеров для анализа и обработки огромного количества данных на естественном языке.

История НЛП

Мы разделили историю НЛП на четыре этапа. Фазы имеют отличительные проблемы и стили.

Первая фаза (фаза машинного перевода) — конец 1940-х — конец 1960-х годов

Работа, проделанная на этом этапе, была сосредоточена главным образом на машинном переводе (MT). Этот этап был периодом энтузиазма и оптимизма.

Давайте теперь посмотрим, что было на первом этапе —

-

Исследование НЛП началось в начале 1950-х годов после расследования Бута и Риченса и меморандума Уивера по машинному переводу в 1949 году.

-

1954 год был годом, когда в эксперименте Джорджтаун-IBM был продемонстрирован ограниченный эксперимент по автоматическому переводу с русского на английский.

-

В том же году началась публикация журнала MT (Machine Translation).

-

Первая международная конференция по машинному переводу (МТ) состоялась в 1952 году, а вторая — в 1956 году.

-

В 1961 году кульминацией этого этапа стала работа, представленная на Международной конференции по машинному переводу языков и прикладному языку в Теддингтоне.

Исследование НЛП началось в начале 1950-х годов после расследования Бута и Риченса и меморандума Уивера по машинному переводу в 1949 году.

1954 год был годом, когда в эксперименте Джорджтаун-IBM был продемонстрирован ограниченный эксперимент по автоматическому переводу с русского на английский.

В том же году началась публикация журнала MT (Machine Translation).

Первая международная конференция по машинному переводу (МТ) состоялась в 1952 году, а вторая — в 1956 году.

В 1961 году кульминацией этого этапа стала работа, представленная на Международной конференции по машинному переводу языков и прикладному языку в Теддингтоне.

Вторая фаза (фаза влияния ИИ) — конец 1960-х — конец 1970-х годов

На этом этапе проделанная работа была в основном связана с мировым знанием и его ролью в построении и манипулировании смысловыми представлениями. Вот почему эта фаза также называется AI-ароматизированной фазой.

Этап был в нем, следующее —

-

В начале 1961 года началась работа над проблемами решения и построения базы данных или знаний. Эта работа была под влиянием AI.

-

В том же году была разработана система ответов на вопросы BASEBALL. Вход в эту систему был ограничен, и языковая обработка была простой.

-

Очень продвинутая система была описана в Минском (1968). Эта система, по сравнению с системой ответов на вопросы BASEBALL, была признана и предусмотрена для необходимости определения базы знаний при интерпретации и реагировании на ввод языка.

В начале 1961 года началась работа над проблемами решения и построения базы данных или знаний. Эта работа была под влиянием AI.

В том же году была разработана система ответов на вопросы BASEBALL. Вход в эту систему был ограничен, и языковая обработка была простой.

Очень продвинутая система была описана в Минском (1968). Эта система, по сравнению с системой ответов на вопросы BASEBALL, была признана и предусмотрена для необходимости определения базы знаний при интерпретации и реагировании на ввод языка.

Третья фаза (грамматико-логическая фаза) — конец 1970-х — конец 1980-х годов

Эта фаза может быть описана как грамматико-логическая фаза. Из-за неудачи практического построения системы на последнем этапе исследователи перешли к использованию логики для представления знаний и рассуждения в ИИ.

На третьем этапе было следующее:

-

Грамматико-логический подход к концу десятилетия помог нам с мощными процессорами предложений общего назначения, такими как Core Language Engine и Теория репрезентации дискурса, которые предлагали средства для решения более расширенного дискурса.

-

На этом этапе мы получили некоторые практические ресурсы и инструменты, такие как парсеры, например Alvey Natural Language Tools, а также более оперативные и коммерческие системы, например, для запросов к базе данных.

-

Работа над лексикой в 1980-х годах также указала в направлении грамматического подхода.

Грамматико-логический подход к концу десятилетия помог нам с мощными процессорами предложений общего назначения, такими как Core Language Engine и Теория репрезентации дискурса, которые предлагали средства для решения более расширенного дискурса.

На этом этапе мы получили некоторые практические ресурсы и инструменты, такие как парсеры, например Alvey Natural Language Tools, а также более оперативные и коммерческие системы, например, для запросов к базе данных.

Работа над лексикой в 1980-х годах также указала в направлении грамматического подхода.

Четвертая фаза (Lexical & Corpus Phase) — 1990-е годы

Мы можем описать это как лексическую и корпусную фазу. Эта фаза имела лексический подход к грамматике, который появился в конце 1980-х годов и приобрел все большее влияние. В этом десятилетии произошла революция в обработке естественного языка с введением алгоритмов машинного обучения для обработки языка.

Изучение человеческих языков

Язык является важнейшим компонентом человеческой жизни, а также самым фундаментальным аспектом нашего поведения. Мы можем испытать это в основном в двух формах — письменной и устной. В письменной форме это способ передать наши знания из поколения в поколение. В разговорной форме это является первичной средой для координации людей друг с другом в их повседневном поведении. Язык изучается в различных академических дисциплинах. Каждая дисциплина имеет свой собственный набор проблем и набор решений для их решения.

Рассмотрим следующую таблицу, чтобы понять это —

| дисциплина | Проблемы | инструменты |

|---|---|---|

|

Лингвисты |

Как фразы и предложения могут быть составлены из слов? Что ограничивает возможный смысл предложения? |

Интуиция о правильности и значении. Математическая модель строения. Например, теоретическая семантика модели, теория формального языка. |

|

психолингвистов |

Как люди могут определить структуру предложений? Как определить значение слов? Когда происходит понимание? |

Экспериментальные методы в основном для измерения производительности людей. Статистический анализ наблюдений. |

|

Философы |

Как слова и предложения приобретают смысл? Как объекты идентифицируются по словам? Что это значит? |

Аргументация естественного языка с помощью интуиции. Математические модели, такие как логика и теория моделей. |

|

Вычислительные лингвисты |

Как мы можем определить структуру предложения Как можно смоделировать знания и рассуждения? Как мы можем использовать язык для выполнения конкретных задач? |

Алгоритмы Структуры данных Формальные модели представления и рассуждения. AI методы, такие как методы поиска и представления. |

Лингвисты

Как фразы и предложения могут быть составлены из слов?

Что ограничивает возможный смысл предложения?

Интуиция о правильности и значении.

Математическая модель строения. Например, теоретическая семантика модели, теория формального языка.

психолингвистов

Как люди могут определить структуру предложений?

Как определить значение слов?

Когда происходит понимание?

Экспериментальные методы в основном для измерения производительности людей.

Статистический анализ наблюдений.

Философы

Как слова и предложения приобретают смысл?

Как объекты идентифицируются по словам?

Что это значит?

Аргументация естественного языка с помощью интуиции.

Математические модели, такие как логика и теория моделей.

Вычислительные лингвисты

Как мы можем определить структуру предложения

Как можно смоделировать знания и рассуждения?

Как мы можем использовать язык для выполнения конкретных задач?

Алгоритмы

Структуры данных

Формальные модели представления и рассуждения.

AI методы, такие как методы поиска и представления.

Неопределенность и неопределенность в языке

Неоднозначность, обычно используемая в обработке естественного языка, может быть названа как способность быть понятой более чем одним способом. Проще говоря, мы можем сказать, что двусмысленность — это способность быть понятой более чем одним способом. Естественный язык очень неоднозначен. НЛП имеет следующие виды неясностей —

Лексическая Неоднозначность

Неоднозначность одного слова называется лексической двусмысленностью. Например, рассматривая слово серебро как существительное, прилагательное или глагол.

Синтаксическая Неопределенность

Такая двусмысленность возникает, когда предложение разбирается по-разному. Например, предложение «Мужчина увидел девушку с телескопом». Не ясно, видел ли мужчина девушку с телескопом или видел ее через телескоп.

Семантическая двусмысленность

Такая двусмысленность возникает, когда значение самих слов может быть неправильно истолковано. Другими словами, семантическая неоднозначность возникает, когда предложение содержит неоднозначное слово или фразу. Например, предложение «Автомобиль врезался в столб, когда он двигался», имеет семантическую двусмысленность, потому что интерпретации могут быть такими: «Автомобиль, двигаясь, врезается в столб» и «Автомобиль врезался в столб, когда столб двигался».

Анафорическая Неоднозначность

Такая двусмысленность возникает из-за использования в дискурсе анафорных сущностей. Например, лошадь побежала в гору. Это было очень круто. Скоро надоело. Здесь анафорическая ссылка на «это» в двух ситуациях вызывает неоднозначность.

Прагматическая двусмысленность

Такая двусмысленность относится к ситуации, когда контекст фразы дает ей несколько толкований. Проще говоря, мы можем сказать, что прагматическая двусмысленность возникает, когда утверждение не является конкретным. Например, предложение «ты мне тоже нравишься» может иметь несколько толкований, как ты мне нравишься (так же, как я тебе нравлюсь), ты мне нравишься (точно так же, как кто-то другой).

Фазы НЛП

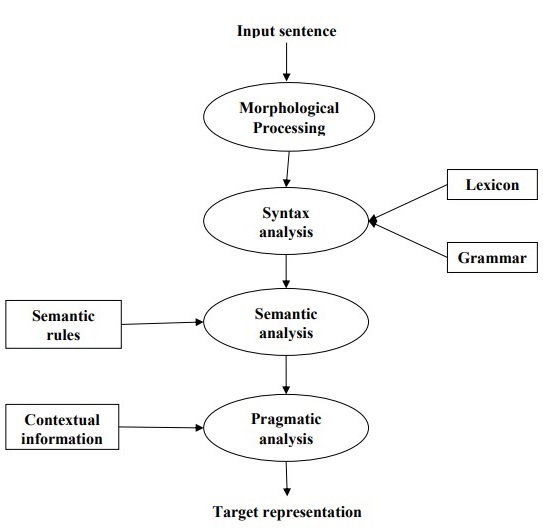

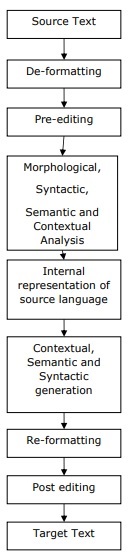

Следующая диаграмма показывает фазы или логические шаги в обработке естественного языка —

Морфологическая обработка

Это первая фаза НЛП. Целью этого этапа является разбиение фрагментов ввода языка на наборы токенов, соответствующих абзацам, предложениям и словам. Например, слово типа «непростое» можно разбить на два токена подслов как «непростое» .

Синтаксический анализ

Это вторая фаза НЛП. Цель этого этапа состоит в двух направлениях: проверить, правильно ли сформировано предложение или нет, и разбить его на структуру, которая показывает синтаксические отношения между различными словами. Например, предложение типа «Школа идет к мальчику» будет отклонено синтаксическим анализатором или анализатором.

Семантический анализ

Это третья фаза НЛП. Цель этого этапа — нарисовать точное значение, или вы можете сказать значение словаря из текста. Текст проверен на осмысленность. Например, семантический анализатор отклонил бы предложение типа «Горячее мороженое».

Прагматический анализ

Это четвертая фаза НЛП. Прагматический анализ просто сопоставляет фактические объекты / события, которые существуют в данном контексте, с объектными ссылками, полученными на последнем этапе (семантический анализ). Например, предложение «Положите банан в корзину на полке» может иметь две семантические интерпретации, и прагматический анализатор будет выбирать между этими двумя возможностями.

НЛП — Лингвистические ресурсы

В этой главе мы узнаем о лингвистических ресурсах в обработке естественного языка.

тело

Корпус — это большой и структурированный набор машиночитаемых текстов, которые были созданы в естественной коммуникативной обстановке. Его множественное число является корпусом. Они могут быть получены по-разному, например, текст, который был первоначально электронным, стенограммы разговорного языка и оптического распознавания символов и т. Д.

Элементы Корпус Дизайн

Язык бесконечен, но корпус должен быть конечным по размеру. Чтобы корпус был конечным по размеру, нам нужно выполнить выборку и пропорционально включить широкий спектр типов текста, чтобы обеспечить хороший дизайн корпуса.

Давайте теперь узнаем о некоторых важных элементах дизайна корпуса —

Представительность корпуса

Репрезентативность является определяющей чертой дизайна корпуса. Следующие определения двух великих исследователей — Пиявки и Бибера, помогут нам понять представительность корпуса —

-

Согласно Leech (1991), «корпус считается представителем языкового разнообразия, которое он должен представлять, если результаты, основанные на его содержании, могут быть обобщены до указанного языкового разнообразия».

-

Согласно Biber (1993), «репрезентативность относится к степени, в которой выборка включает полный диапазон изменчивости в популяции».

Согласно Leech (1991), «корпус считается представителем языкового разнообразия, которое он должен представлять, если результаты, основанные на его содержании, могут быть обобщены до указанного языкового разнообразия».

Согласно Biber (1993), «репрезентативность относится к степени, в которой выборка включает полный диапазон изменчивости в популяции».

Таким образом, мы можем сделать вывод, что репрезентативность корпуса определяется следующими двумя факторами:

-

Баланс — Диапазон жанров включает в себя корпус

-

Выборка — Как выбираются фрагменты для каждого жанра.

Баланс — Диапазон жанров включает в себя корпус

Выборка — Как выбираются фрагменты для каждого жанра.

Корпус Баланс

Другой очень важный элемент дизайна корпуса — баланс корпуса — диапазон жанра, включенного в корпус. Мы уже изучали, что репрезентативность общего корпуса зависит от того, насколько сбалансирован корпус. Сбалансированный корпус охватывает широкий спектр текстовых категорий, которые должны быть представителями языка. У нас нет какой-либо надежной научной меры для баланса, но лучшая оценка и интуиция работают в этом отношении. Другими словами, мы можем сказать, что принятый баланс определяется только его предполагаемым использованием.

отбор проб

Другим важным элементом дизайна корпуса является выборка. Репрезентативность и сбалансированность корпуса очень тесно связаны с отбором проб. Вот почему мы можем сказать, что выборка неизбежна при построении корпуса.

-

Согласно Биберу (1993) , «некоторые из первых соображений при построении корпуса касаются общего дизайна: например, типы включенных текстов, количество текстов, выбор конкретных текстов, выбор образцов текста из текстов. и длина образцов текста. Каждый из них включает выборочное решение, сознательное или нет ».

Согласно Биберу (1993) , «некоторые из первых соображений при построении корпуса касаются общего дизайна: например, типы включенных текстов, количество текстов, выбор конкретных текстов, выбор образцов текста из текстов. и длина образцов текста. Каждый из них включает выборочное решение, сознательное или нет ».

При получении репрезентативной выборки нам необходимо учитывать следующее:

-

Единица отбора проб — относится к единице, для которой требуется образец. Например, для письменного текста единицей выборки может быть газета, журнал или книга.

-

Рамка выборки — список всех единиц выборки называется кадром выборки.

-

Население — это можно назвать сборкой всех единиц выборки. Он определяется с точки зрения языкового производства, языкового восприятия или языка как продукта.

Единица отбора проб — относится к единице, для которой требуется образец. Например, для письменного текста единицей выборки может быть газета, журнал или книга.

Рамка выборки — список всех единиц выборки называется кадром выборки.

Население — это можно назвать сборкой всех единиц выборки. Он определяется с точки зрения языкового производства, языкового восприятия или языка как продукта.

Размер корпуса

Другим важным элементом дизайна корпуса является его размер. Насколько большим должен быть корпус? На этот вопрос нет конкретного ответа. Размер корпуса зависит от цели, для которой он предназначен, а также от следующих практических соображений:

-

Вид запроса, ожидаемого от пользователя.

-

Методология, используемая пользователями для изучения данных.

-

Наличие источника данных.

Вид запроса, ожидаемого от пользователя.

Методология, используемая пользователями для изучения данных.

Наличие источника данных.

С прогрессом в технологии, размер корпуса также увеличивается. Следующая таблица сравнения поможет вам понять, как работает размер корпуса —

| Год | Наименование корпуса | Размер (словами) |

|---|---|---|

| 1960-е — 70-е годы | Коричневый и LOB | 1 миллион слов |

| 1980-е годы | Бирмингемская Корпорация | 20 миллионов слов |

| 1990-е годы | Британский национальный корпус | 100 миллионов слов |

| Начало 21 века | Банк английского корпуса | 650 миллионов слов |

В наших последующих разделах мы рассмотрим несколько примеров корпусов.

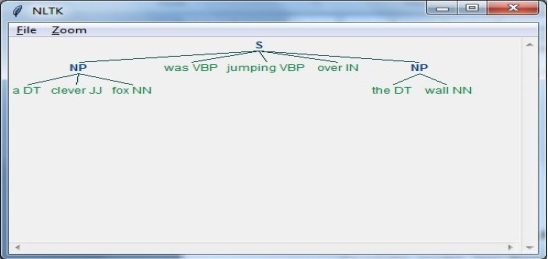

TreeBank Corpus

Он может быть определен как лингвистически проанализированный текстовый корпус, который аннотирует синтаксическую или семантическую структуру предложения. Джеффри Лич ввел термин «древовидный банк», который означает, что наиболее распространенным способом представления грамматического анализа является древовидная структура. Как правило, древовидные банки создаются в верхней части корпуса, который уже снабжен тегами части речи.

Типы TreeBank Корпус

Семантические и синтаксические древовидные банки являются двумя наиболее распространенными типами древовидных банков в лингвистике. Давайте теперь узнаем больше об этих типах —

Семантические древовидные

Эти древовидные банки используют формальное представление семантической структуры предложения. Они различаются по глубине своего семантического представления. Команды роботов Treebank, Geoquery, Groningen Meaning Bank, RoboCup Corpus — вот некоторые примеры семантических древовидных банков.

Синтаксические древовидные

В отличие от семантических древовидных банков входные данные для систем синтаксического древовидного банка являются выражениями формального языка, полученного в результате преобразования проанализированных данных древовидного банка. Выходы таких систем основаны на предикатном логическом значении представления. К настоящему времени созданы различные синтаксические древовидные блоки на разных языках. Например, Penn Arabic Treebank, Columbia Arabic Treebank — это синтаксические Treebank, созданные на арабском языке. Sininca синтаксический Treebank создан на китайском языке. Люси, Сьюзен и BLLIP WSJ создали синтаксический корпус на английском языке.

Приложения TreeBank Corpus

Ниже приведены некоторые из приложений TreeBanks —

В компьютерной лингвистике

Если мы говорим о вычислительной лингвистике, то лучше всего использовать TreeBanks для разработки современных систем обработки естественного языка, таких как метки части речи, парсеры, семантические анализаторы и системы машинного перевода.

В корпусе лингвистики

В случае корпусной лингвистики лучше всего использовать древовидные банки для изучения синтаксических явлений.

В теоретической лингвистике и психолингвистике

Лучшее использование древовидных банков в теоретической и психолингвистической практике — это доказательство взаимодействия.

ПропБанк Корпус

PropBank, более конкретно называемый «Банком предложений», представляет собой корпус, который снабжен устными предложениями и их аргументами. Корпус — это ресурс, ориентированный на глагол; аннотации здесь более тесно связаны с синтаксическим уровнем. Марта Палмер и др., Отделение лингвистики, Университет Колорадо, Боулдер разработали его. Мы можем использовать термин PropBank как обычное существительное, относящееся к любому корпусу, который аннотирован предложениями и их аргументами.

В области обработки естественного языка (NLP) проект PropBank сыграл очень важную роль. Это помогает в семантической ролевой маркировке.

VerbNet (VN),

VerbNet (VN) — это иерархический независимый от домена и самый большой лексический ресурс, представленный на английском языке, который включает как семантическую, так и синтаксическую информацию о его содержимом. VN — это глагол широкого охвата, имеющий сопоставления с другими лексическими ресурсами, такими как WordNet, Xtag и FrameNet. Он организован в классы глаголов, расширяющие классы Левина путем уточнения и добавления подклассов для достижения синтаксической и семантической согласованности среди членов класса.

Каждый класс VerbNet (VN) содержит —

Набор синтаксических описаний или синтаксических фреймов

Для изображения возможных поверхностных реализаций структуры аргумента для таких конструкций, как транзитивные, непереходные, пропозициональные фразы, результативные и большой набор чередований диатезов.

Набор семантических описаний, таких как анимация, человек, организация

Для ограничения, типы тематических ролей, разрешенных аргументами, и дополнительные ограничения могут быть наложены. Это поможет в указании синтаксической природы компонента, который может быть связан с тематической ролью.

WordNet

WordNet, созданный Princeton, представляет собой лексическую базу данных для английского языка. Это часть корпуса НЛТК. В WordNet существительные, глаголы, прилагательные и наречия группируются в наборы когнитивных синонимов, называемых Синсетами . Все синтаксисы связаны с помощью концептуально-семантических и лексических отношений. Его структура делает его очень полезным для обработки естественного языка (НЛП).

В информационных системах WordNet используется для различных целей, таких как устранение неоднозначности слов, поиск информации, автоматическая классификация текста и машинный перевод. Одним из наиболее важных применений WordNet является выявление сходства между словами. Для этой задачи в различных пакетах были реализованы различные алгоритмы, такие как Similarity в Perl, NLTK в Python и ADW в Java.

НЛП — Анализ на уровне слов

В этой главе мы разберемся с анализом мирового уровня в обработке естественного языка.

Регулярные выражения

Регулярное выражение (RE) — это язык для указания строк текстового поиска. RE помогает нам сопоставлять или находить другие строки или наборы строк, используя специальный синтаксис, содержащийся в шаблоне. Регулярные выражения используются для поиска текстов в UNIX, а также в MS WORD одинаковым способом. У нас есть различные поисковые системы, использующие ряд функций RE.

Свойства регулярных выражений

Ниже приведены некоторые важные свойства RE —

-

Американский математик Стивен Коул Клин формализовал язык регулярных выражений.

-

RE — это формула на специальном языке, которую можно использовать для указания простых классов строк, последовательности символов. Другими словами, мы можем сказать, что RE является алгебраической нотацией для характеристики набора строк.

-

Регулярное выражение требует двух вещей: одна — это шаблон, который мы хотим искать, а другая — это совокупность текста, из которого мы должны искать.

Американский математик Стивен Коул Клин формализовал язык регулярных выражений.

RE — это формула на специальном языке, которую можно использовать для указания простых классов строк, последовательности символов. Другими словами, мы можем сказать, что RE является алгебраической нотацией для характеристики набора строк.

Регулярное выражение требует двух вещей: одна — это шаблон, который мы хотим искать, а другая — это совокупность текста, из которого мы должны искать.

Математически Регулярное выражение может быть определено следующим образом:

-

ε является регулярным выражением, которое указывает, что язык имеет пустую строку.

-

φ является регулярным выражением, которое обозначает, что это пустой язык.

-

Если X и Y являются регулярными выражениями, то

-

X, Y

-

XY (объединение XY)

-

X + Y (Союз X и Y)

-

X *, Y * (Клин Закрытие X и Y)

-

ε является регулярным выражением, которое указывает, что язык имеет пустую строку.

φ является регулярным выражением, которое обозначает, что это пустой язык.

Если X и Y являются регулярными выражениями, то

X, Y

XY (объединение XY)

X + Y (Союз X и Y)

X *, Y * (Клин Закрытие X и Y)

также регулярные выражения.

-

Если строка получена из вышеуказанных правил, то это также будет регулярное выражение.

Если строка получена из вышеуказанных правил, то это также будет регулярное выражение.

Примеры регулярных выражений

В следующей таблице приведены несколько примеров регулярных выражений:

| Регулярные выражения | Обычный набор |

|---|---|

| (0 + 10 *) | {0, 1, 10, 100, 1000, 10000,…} |

| (0 * 10 *) | {1, 01, 10, 010, 0010,…} |

| (0 + ε) (1 + ε) | {ε, 0, 1, 01} |

| (А + б) * | Это будет набор строк a и b любой длины, который также содержит пустую строку, т. Е. {Ε, a, b, aa, ab, bb, ba, aaa …….} |

| (А + б) * АВВ | Это будет набор строк из a и b, оканчивающихся строкой abb, т.е. {abb, aabb, babb, aaabb, ababb, ………… ..} |

| (11) * | Это будет набор, состоящий из четного числа 1, которое также содержит пустую строку, т. Е. {Ε, 11, 1111, 111111, ……….} |

| (Аа) * (бб) * б | Это будет набор строк, состоящий из четного числа a, за которым следует нечетное количество b, т.е. {b, aab, aabbb, aabbbbb, aaaab, aaaabbb, ………… ..} |

| (aa + ab + ba + bb) * | Это будет строка a и b одинаковой длины, которая может быть получена путем объединения любой комбинации строк aa, ab, ba и bb, включая ноль, т. Е. {Aa, ab, ba, bb, aaab, aaba, …………. .} |

Регулярные множества и их свойства

Он может быть определен как набор, который представляет значение регулярного выражения и состоит из определенных свойств.

Свойства регулярных множеств

-

Если мы сделаем объединение двух регулярных наборов, то результирующий набор также будет регулярным.

-

Если мы сделаем пересечение двух регулярных множеств, то результирующий набор также будет регулярным.

-

Если мы сделаем дополнение регулярных множеств, то результирующий набор также будет регулярным.

-

Если мы сделаем различие двух регулярных наборов, то результирующий набор также будет регулярным.

-

Если мы сделаем обращение регулярных множеств, то результирующий набор также будет регулярным.

-

Если мы возьмем замыкание регулярных множеств, то результирующий набор также будет регулярным.

-

Если мы сделаем объединение двух регулярных наборов, то результирующий набор также будет регулярным.

Если мы сделаем объединение двух регулярных наборов, то результирующий набор также будет регулярным.

Если мы сделаем пересечение двух регулярных множеств, то результирующий набор также будет регулярным.

Если мы сделаем дополнение регулярных множеств, то результирующий набор также будет регулярным.

Если мы сделаем различие двух регулярных наборов, то результирующий набор также будет регулярным.

Если мы сделаем обращение регулярных множеств, то результирующий набор также будет регулярным.

Если мы возьмем замыкание регулярных множеств, то результирующий набор также будет регулярным.

Если мы сделаем объединение двух регулярных наборов, то результирующий набор также будет регулярным.

Конечные Государственные Автоматы

Термин «автоматы», производный от греческого слова «αὐτόματα», означающего «самодействующий», является множественным числом автомата, которое может быть определено как абстрактное самоходное вычислительное устройство, которое автоматически следует заданной последовательности операций.

Автомат с конечным числом состояний называется конечным автоматом (FA) или конечным автоматом (FSA).

Математически автомат может быть представлен 5-кортежем (Q, Σ, δ, q0, F), где —

-

Q — конечное множество состояний.

-

Σ — это конечный набор символов, называемый алфавитом автомата.

-

δ — функция перехода

-

q0 — начальное состояние, из которого обрабатывается любой вход (q0 ∈ Q).

-

F — множество конечных состояний / состояний Q (F ⊆ Q).

Q — конечное множество состояний.

Σ — это конечный набор символов, называемый алфавитом автомата.

δ — функция перехода

q0 — начальное состояние, из которого обрабатывается любой вход (q0 ∈ Q).

F — множество конечных состояний / состояний Q (F ⊆ Q).

Связь между конечными автоматами, регулярными грамматиками и регулярными выражениями

Следующие пункты дадут нам четкое представление о связи между конечными автоматами, регулярными грамматиками и регулярными выражениями —

-

Поскольку мы знаем, что конечные автоматы являются теоретической основой вычислительной работы, а регулярные выражения являются одним из способов их описания.

-

Можно сказать, что любое регулярное выражение может быть реализовано как FSA, а любое FSA может быть описано с помощью регулярного выражения.

-

С другой стороны, регулярное выражение — это способ охарактеризовать разновидность языка, называемого регулярным языком. Следовательно, мы можем сказать, что регулярный язык может быть описан как с помощью FSA, так и регулярного выражения.

-

Регулярная грамматика, формальная грамматика, которая может быть правильной или правильной слева, является еще одним способом характеристики обычного языка.

Поскольку мы знаем, что конечные автоматы являются теоретической основой вычислительной работы, а регулярные выражения являются одним из способов их описания.

Можно сказать, что любое регулярное выражение может быть реализовано как FSA, а любое FSA может быть описано с помощью регулярного выражения.

С другой стороны, регулярное выражение — это способ охарактеризовать разновидность языка, называемого регулярным языком. Следовательно, мы можем сказать, что регулярный язык может быть описан как с помощью FSA, так и регулярного выражения.

Регулярная грамматика, формальная грамматика, которая может быть правильной или правильной слева, является еще одним способом характеристики обычного языка.

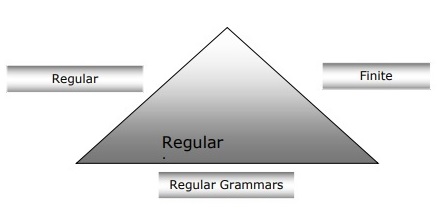

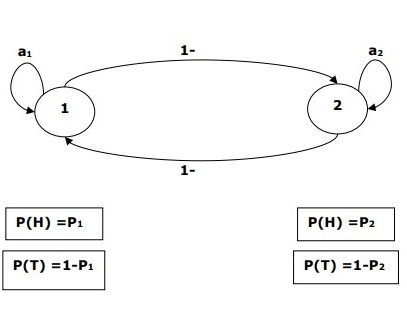

Следующая диаграмма показывает, что конечные автоматы, регулярные выражения и регулярные грамматики являются эквивалентными способами описания регулярных языков.

Типы конечной государственной автоматизации (ФСА)

Автоматизация конечных состояний бывает двух типов. Давайте посмотрим, что это за типы.

Детерминированная конечная автоматизация (DFA)

Это может быть определено как тип конечной автоматизации, в которой для каждого входного символа мы можем определить состояние, в которое машина перейдет. Он имеет конечное число состояний, поэтому машина называется детерминированным конечным автоматом (DFA).

Математически DFA может быть представлен 5-кортежем (Q, Σ, δ, q0, F), где —

-

Q — конечное множество состояний.

-

Σ — это конечный набор символов, называемый алфавитом автомата.

-

δ — функция перехода, где δ: Q × Σ → Q.

-

q0 — начальное состояние, из которого обрабатывается любой вход (q0 ∈ Q).

-

F — множество конечных состояний / состояний Q (F ⊆ Q).

Q — конечное множество состояний.

Σ — это конечный набор символов, называемый алфавитом автомата.

δ — функция перехода, где δ: Q × Σ → Q.

q0 — начальное состояние, из которого обрабатывается любой вход (q0 ∈ Q).

F — множество конечных состояний / состояний Q (F ⊆ Q).

В то время как графически DFA может быть представлен диаграммами, называемыми диаграммами состояний, где —

-

Состояния представлены вершинами .

-

Переходы показаны помеченными дугами .

-

Начальное состояние представлено пустой входящей дугой .

-

Конечное состояние представлено двойным кружком .

Состояния представлены вершинами .

Переходы показаны помеченными дугами .

Начальное состояние представлено пустой входящей дугой .

Конечное состояние представлено двойным кружком .

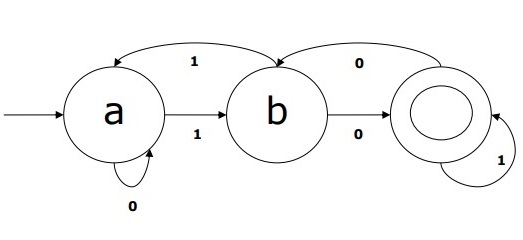

Пример ДФА

Предположим, что DFA будет

-

Q = {a, b, c},

-

Σ = {0, 1},

-

q 0 = {а},

-

F = {c},

-

Функция перехода δ показана в таблице следующим образом:

Q = {a, b, c},

Σ = {0, 1},

q 0 = {а},

F = {c},

Функция перехода δ показана в таблице следующим образом:

| Текущее состояние | Следующее состояние для ввода 0 | Следующее состояние для ввода 1 |

|---|---|---|

| В | ||

| В | б | |

| С | с | С |

Графическое представление этого DFA будет следующим:

Недетерминированная конечная автоматизация (NDFA)

Это может быть определено как тип конечной автоматизации, где для каждого входного символа мы не можем определить состояние, в которое будет перемещаться машина, т.е. машина может перейти в любую комбинацию состояний. Он имеет конечное число состояний, поэтому машина называется недетерминированной конечной автоматизацией (NDFA).

Математически NDFA может быть представлен 5-кортежем (Q, Σ, δ, q0, F), где —

-

Q — конечное множество состояний.

-

Σ — это конечный набор символов, называемый алфавитом автомата.

-

δ: — функция перехода, где δ: Q × Σ → 2 Q.

-

q0: — начальное состояние, из которого обрабатывается любой вход (q0 ∈ Q).

-

F: -множество конечного состояния / состояний Q (F ⊆ Q).

Q — конечное множество состояний.

Σ — это конечный набор символов, называемый алфавитом автомата.

δ: — функция перехода, где δ: Q × Σ → 2 Q.

q0: — начальное состояние, из которого обрабатывается любой вход (q0 ∈ Q).

F: -множество конечного состояния / состояний Q (F ⊆ Q).

В то время как графически (так же, как DFA), NDFA может быть представлен диаграммами, называемыми диаграммами состояний, где —

-

Состояния представлены вершинами .

-

Переходы показаны помеченными дугами .

-

Начальное состояние представлено пустой входящей дугой .

-

Конечное состояние представлено двойным кружком .

Состояния представлены вершинами .

Переходы показаны помеченными дугами .

Начальное состояние представлено пустой входящей дугой .

Конечное состояние представлено двойным кружком .

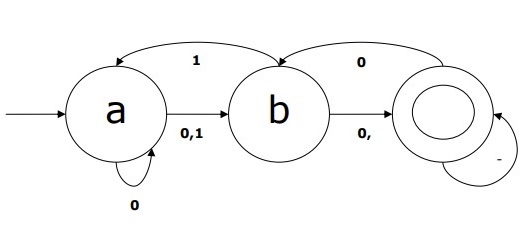

Пример NDFA

Предположим, что NDFA будет

-

Q = {a, b, c},

-

Σ = {0, 1},

-

q 0 = {а},

-

F = {c},

-

Функция перехода δ показана в таблице следующим образом:

Q = {a, b, c},

Σ = {0, 1},

q 0 = {а},

F = {c},

Функция перехода δ показана в таблице следующим образом:

| Текущее состояние | Следующее состояние для ввода 0 | Следующее состояние для ввода 1 |

|---|---|---|

| а, б | В | |

| В | С | а, с |

| С | До нашей эры | С |

Графическое представление этого NDFA будет следующим:

Морфологический анализ

Термин морфологический анализ связан с анализом морфем. Мы можем определить морфологический анализ как проблему распознавания того, что слово разбивается на более мелкие значимые единицы, называемые морфемами, создавая для него некую лингвистическую структуру. Например, мы можем разбить слово « лисы» на два, « лиса» и « -ес» . Мы видим, что слово « лисы» состоит из двух морфем: одна — лиса, а другая — «да».

В другом смысле мы можем сказать, что морфология — это изучение

-

Формирование слов.

-

Происхождение слов.

-

Грамматические формы слов.

-

Использование префиксов и суффиксов в образовании слов.

-

Как формируются части речи (PoS) языка.

Формирование слов.

Происхождение слов.

Грамматические формы слов.

Использование префиксов и суффиксов в образовании слов.

Как формируются части речи (PoS) языка.

Типы морфем

Морфемы, наименьшие смыслосодержащие единицы, можно разделить на два типа:

-

Стебли

-

Порядок слов

Стебли

Порядок слов

Стебли

Это основная смысловая единица слова. Можно также сказать, что это корень слова. Например, в слове лисы ствол — лиса.

-

Аффиксы. Как следует из названия, они добавляют словам дополнительный смысл и грамматические функции. Например, в слове «лисы» аффикс — ес.

Аффиксы. Как следует из названия, они добавляют словам дополнительный смысл и грамматические функции. Например, в слове «лисы» аффикс — ес.

Кроме того, аффиксы также можно разделить на следующие четыре типа:

-

Префиксы. Как следует из названия, префиксы предшествуют основам. Например, в слове unbuckle un является префиксом.

-

Суффиксы — Как следует из названия, суффиксы следуют за основанием. Например, в слове кошки суффикс -s.

-

Инфиксы — Как следует из названия, инфиксы вставляются в ствол. Например, слово cupful можно использовать для множественного числа как cupsful, используя -s в качестве инфикса.

-

Circumfixes — они предшествуют и следуют за стеблем. Примеров обрезаний на английском языке очень мало. Очень распространенный пример — «A-ing», где мы можем использовать -A перед, а -ing после ствола.

Префиксы. Как следует из названия, префиксы предшествуют основам. Например, в слове unbuckle un является префиксом.

Суффиксы — Как следует из названия, суффиксы следуют за основанием. Например, в слове кошки суффикс -s.

Инфиксы — Как следует из названия, инфиксы вставляются в ствол. Например, слово cupful можно использовать для множественного числа как cupsful, используя -s в качестве инфикса.

Circumfixes — они предшествуют и следуют за стеблем. Примеров обрезаний на английском языке очень мало. Очень распространенный пример — «A-ing», где мы можем использовать -A перед, а -ing после ствола.

Порядок слов

Порядок слов будет определяться путем морфологического анализа. Давайте теперь посмотрим требования для построения морфологического парсера —

Словарный запас

Самым первым требованием для построения морфологического синтаксического анализатора является лексикон, который включает в себя список основ и аффиксов вместе с основной информацией о них. Например, информация о том, является ли ствол существительным или глагольным стволом и т. Д.

Morphotactics

В основном это модель упорядочения морфем. В другом смысле модель, объясняющая, какие классы морфем могут следовать за другими классами морфем внутри слова. Например, морфотаксический факт заключается в том, что морфема английского множественного числа всегда следует за существительным, а не предшествует ему.

Орфографические правила

Эти правила правописания используются для моделирования изменений, происходящих в слове. Например, правило преобразования у в слова, например, город + с = города, а не города.

Обработка естественного языка — синтаксический анализ

Синтаксический анализ, синтаксический анализ или синтаксический анализ — это третья фаза НЛП. Цель этого этапа — нарисовать точное значение, или вы можете сказать значение словаря из текста. Синтаксический анализ проверяет текст на предмет значимости по сравнению с правилами формальной грамматики. Например, предложение типа «горячее мороженое» будет отклонено семантическим анализатором.

В этом смысле синтаксический анализ или синтаксический анализ могут быть определены как процесс анализа строк символов на естественном языке в соответствии с правилами формальной грамматики. Происхождение слова «парсинг» происходит от латинского слова «парс», что означает «часть» .

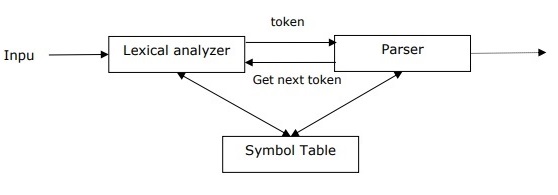

Концепция парсера

Используется для реализации задачи разбора. Он может быть определен как программный компонент, предназначенный для сбора входных данных (текста) и обеспечения структурного представления входных данных после проверки правильности синтаксиса в соответствии с формальной грамматикой. Он также строит структуру данных, как правило, в форме дерева разбора или абстрактного синтаксического дерева или другой иерархической структуры.

Основные роли разбора включают в себя —

-

Чтобы сообщить о любой синтаксической ошибке.

-

Для восстановления после часто встречающейся ошибки, чтобы можно было продолжить обработку оставшейся части программы.

-

Создать дерево разбора.

-

Создать таблицу символов.

-

Производить промежуточные представления (IR).

Чтобы сообщить о любой синтаксической ошибке.

Для восстановления после часто встречающейся ошибки, чтобы можно было продолжить обработку оставшейся части программы.

Создать дерево разбора.

Создать таблицу символов.

Производить промежуточные представления (IR).

Типы разбора

Вывод делит синтаксический анализ на следующие два типа:

-

Разбор сверху вниз

-

Анализ снизу вверх

Разбор сверху вниз

Анализ снизу вверх

Разбор сверху вниз

При таком разборе синтаксический анализатор начинает строить дерево разбора из начального символа, а затем пытается преобразовать начальный символ во входные данные. Наиболее распространенная форма синтаксического анализа сверху вниз использует рекурсивную процедуру для обработки ввода. Основным недостатком разбора рекурсивного спуска является возврат.

Анализ снизу вверх

При таком анализе синтаксический анализатор начинается с входного символа и пытается построить дерево синтаксического анализатора до начального символа.

Концепция деривации

Чтобы получить входную строку, нам нужна последовательность правил производства. Вывод — это набор правил производства. Во время синтаксического анализа нам нужно выбрать нетерминал, который должен быть заменен, вместе с решением производственного правила, с помощью которого нетерминал будет заменен.

Типы деривации

В этом разделе мы узнаем о двух типах дериваций, которые можно использовать, чтобы решить, какой нетерминал следует заменить производственным правилом —

Самый левый вывод

В самом левом выводе предложенная форма ввода сканируется и заменяется слева направо. Форма предложения в этом случае называется формой слева.

Самый правый вывод

В крайнем левом выводе предложенная форма ввода сканируется и заменяется справа налево. Форма предложения в этом случае называется формой предложения справа.

Концепция разбора дерева

Это может быть определено как графическое изображение деривации. Начальный символ деривации служит корнем дерева разбора. В каждом дереве разбора конечные узлы являются терминалами, а внутренние узлы — нетерминалами. Свойство дерева разбора состоит в том, что обход по порядку будет производить исходную входную строку.

Концепция грамматики

Грамматика очень важна и важна для описания синтаксической структуры правильно сформированных программ. В литературном смысле они обозначают синтаксические правила общения на естественных языках. Лингвистика пыталась определить грамматику с момента появления естественных языков, таких как английский, хинди и т. Д.

Теория формальных языков также применима в области компьютерных наук, главным образом, в языках программирования и структуре данных. Например, в языке «C» правила точной грамматики определяют, как функции создаются из списков и операторов.

Математическая модель грамматики была дана Ноамом Хомским в 1956 году, которая эффективна для написания компьютерных языков.

Математически грамматика G может быть формально записана как 4-кортеж (N, T, S, P), где —

-

N или V N = набор нетерминальных символов, т. Е. Переменных.

-

T или ∑ = набор терминальных символов.

-

S = начальный символ, где S ∈ N

-

P обозначает Производственные правила для Терминалов, а также для Нетерминалов. Он имеет вид α → β, где α и β — строки на V N ∪ ∑, и хотя бы один символ α принадлежит V N

N или V N = набор нетерминальных символов, т. Е. Переменных.

T или ∑ = набор терминальных символов.

S = начальный символ, где S ∈ N

P обозначает Производственные правила для Терминалов, а также для Нетерминалов. Он имеет вид α → β, где α и β — строки на V N ∪ ∑, и хотя бы один символ α принадлежит V N

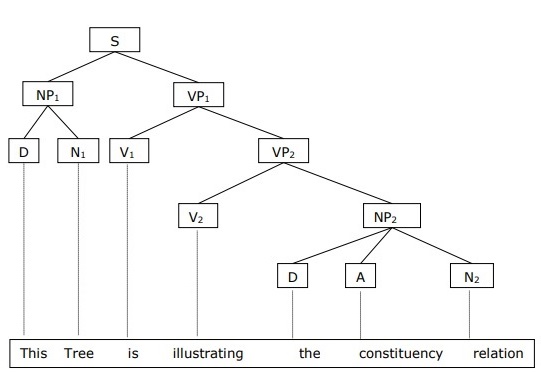

Структура фразы или грамматика избирательного округа

Фраза грамматической структуры, представленная Ноамом Хомским, основана на отношении избирателей. Вот почему это также называется избирательной грамматикой. Это противоположно грамматике зависимости.

пример

Прежде чем приводить пример грамматики избирательного округа, нам необходимо знать основные положения о грамматике избирательного округа и взаимоотношениях с избирателями.

-

Все связанные структуры рассматривают структуру предложения с точки зрения отношения избирателей.

-

Отношение избирательных округов происходит от субъектно-предикатного разделения латинской и греческой грамматики.

-

Основная структура предложения понимается в терминах именной группы NP и глагольной фразы VP .

Все связанные структуры рассматривают структуру предложения с точки зрения отношения избирателей.

Отношение избирательных округов происходит от субъектно-предикатного разделения латинской и греческой грамматики.

Основная структура предложения понимается в терминах именной группы NP и глагольной фразы VP .

Мы можем написать предложение «Это дерево иллюстрирует отношение избирателей» следующим образом:

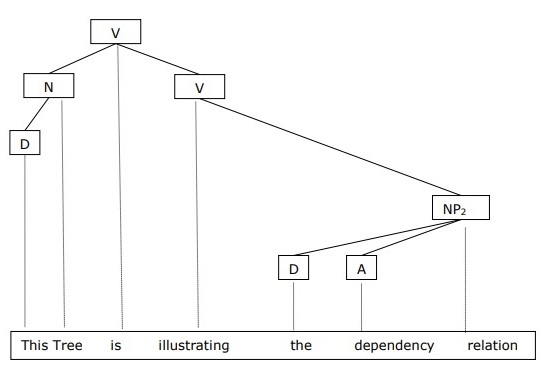

Грамматика зависимости

Это противоположно грамматике избирательного округа и основано на отношении зависимости. Он был представлен Люсьеном Теснере. Грамматика зависимости (DG) противоположна грамматике избирательного округа, потому что в ней отсутствуют фразовые узлы.

пример

Перед тем, как привести пример грамматики зависимости, нам нужно знать основные моменты, касающиеся грамматики зависимости и отношения зависимости.

-

В ГД лингвистические единицы, т. Е. Слова, связаны друг с другом направленными ссылками.

-

Глагол становится центром структуры предложения.

-

Все остальные синтаксические единицы связаны с глаголом в терминах направленной связи. Эти синтаксические единицы называются зависимостями .

В ГД лингвистические единицы, т. Е. Слова, связаны друг с другом направленными ссылками.

Глагол становится центром структуры предложения.

Все остальные синтаксические единицы связаны с глаголом в терминах направленной связи. Эти синтаксические единицы называются зависимостями .

Мы можем написать предложение «Это дерево иллюстрирует отношение зависимости» следующим образом;

Дерево синтаксического анализа, которое использует грамматику постоянных групп, называется основанным на избирательном округе деревом анализа; и деревья разбора, которые используют грамматику зависимости, называются основанным на зависимости деревом разбора.

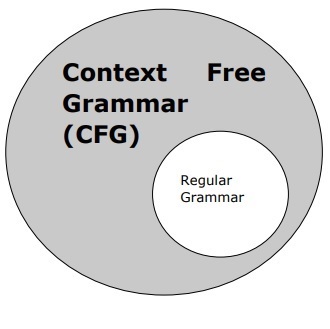

Контекстная бесплатная грамматика

Контекстно-свободная грамматика, также называемая CFG, является нотацией для описания языков и надмножеством регулярной грамматики. Это можно увидеть на следующей диаграмме —

Определение CFG

CFG состоит из конечного набора правил грамматики со следующими четырьмя компонентами:

Набор нетерминалов

Он обозначается буквой V. Нетерминалы — это синтаксические переменные, обозначающие наборы строк, которые дополнительно помогают определить язык, генерируемый грамматикой.

Набор терминалов

Он также называется токеном и определяется как. Строки сформированы с основными символами терминалов.

Набор произведений

Обозначается буквой P. Набор определяет, как клеммы и нетерминалы могут быть объединены. Каждое производство (P) состоит из нетерминалов, стрелки и терминалов (последовательность терминалов). Нетерминалы называются левой стороной производства, а терминалы называются правой стороной производства.

Начальный символ

Производство начинается с начального символа. Он обозначается символом S. Нетерминальный символ всегда обозначается как начальный символ.

Обработка естественного языка — семантический анализ

Цель семантического анализа состоит в том, чтобы нарисовать точное значение, или вы можете сказать значение словаря из текста. Работа семантического анализатора заключается в проверке текста на предмет осмысленности.

Мы уже знаем, что лексический анализ также касается значения слов, тогда чем семантический анализ отличается от лексического анализа? Лексический анализ основан на меньшем токене, но с другой стороны семантический анализ фокусируется на больших кусках. Вот почему семантический анализ можно разделить на следующие две части:

Изучение значения отдельного слова

Это первая часть семантического анализа, в которой проводится изучение значения отдельных слов. Эта часть называется лексической семантикой.

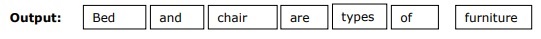

Изучение комбинации отдельных слов

Во второй части отдельные слова будут объединены, чтобы придать смысл предложениям.

Важнейшей задачей семантического анализа является получение правильного значения предложения. Например, проанализируйте предложение «Рам велик». В этом предложении говорящий говорит либо о лорде Раме, либо о человеке по имени Рам. Вот почему важна работа, чтобы получить правильное значение предложения семантического анализатора.

Элементы семантического анализа

Ниже приведены некоторые важные элементы семантического анализа —

Hyponymy

Это может быть определено как связь между общим термином и экземплярами этого общего термина. Здесь общий термин называется гиперным, а его экземпляры называются гипонимами. Например, слово color является гиперным, а цвет blue, yellow и т. Д. Является гипонимом.

Омонимия

Это может быть определено как слова, имеющие одинаковое написание или одинаковую форму, но имеющие различное и несвязанное значение. Например, слово «летучая мышь» является омонимичным словом, потому что летучая мышь может быть орудием для удара по мячу, или летучая мышь также является ночным летающим млекопитающим.

многозначность

Полисемия — это греческое слово, которое означает «много знаков». Это слово или фраза с другим, но связанным смыслом. Другими словами, мы можем сказать, что многозначность имеет то же самое написание, но различное и связанное значение. Например, слово «банк» является многозначным словом, имеющим следующие значения:

-

Финансовое учреждение.

-

Здание, в котором находится такое заведение.

-

Синоним «полагаться».

Финансовое учреждение.

Здание, в котором находится такое заведение.

Синоним «полагаться».

Разница между полисемией и омонимией

И слова многозначности, и слова омонимии имеют одинаковый синтаксис или орфографию. Основное различие между ними состоит в том, что в многозначности значения слов связаны, но в омонимии значения слов не связаны. Например, если мы говорим об одном и том же слове «Банк», мы можем написать значение «финансовое учреждение» или «речной берег». В этом случае это будет пример омонима, потому что значения не связаны друг с другом.

синонимия

Это отношение между двумя лексическими единицами, имеющими разные формы, но выражающими одинаковое или близкое значение. Примерами являются «автор / писатель», «судьба / судьба».

антонимия

Это отношение между двумя лексическими элементами, имеющими симметрию между их семантическими компонентами относительно оси. Сфера антонимии заключается в следующем —

-

Применение собственности или нет — Пример «жизнь / смерть», «уверенность / неуверенность»

-

Применение масштабируемого свойства — пример «богатый / плохой», «горячий / холодный»

-

Применение использования — Пример «отец / сын», «луна / солнце».

Применение собственности или нет — Пример «жизнь / смерть», «уверенность / неуверенность»

Применение масштабируемого свойства — пример «богатый / плохой», «горячий / холодный»

Применение использования — Пример «отец / сын», «луна / солнце».

Значение Представления

Семантический анализ создает представление значения предложения. Но прежде чем углубляться в концепцию и подходы, относящиеся к смысловой репрезентации, нам нужно понять строительные блоки семантической системы.

Строительные блоки семантической системы

В представлении слов или представлении значения слов важную роль играют следующие строительные блоки:

-

Субъекты — это лицо, например, конкретное лицо, место и т. Д. Например, Харьяна. Индия, Рам все сущности.

-

Понятия — представляет общую категорию людей, таких как человек, город и т. Д.

-

Отношения — представляет отношения между сущностями и концепцией. Например, Рам — это человек.

-

Предикаты — Представляет структуру глагола. Например, семантические роли и падежная грамматика являются примерами предикатов.

Субъекты — это лицо, например, конкретное лицо, место и т. Д. Например, Харьяна. Индия, Рам все сущности.

Понятия — представляет общую категорию людей, таких как человек, город и т. Д.

Отношения — представляет отношения между сущностями и концепцией. Например, Рам — это человек.

Предикаты — Представляет структуру глагола. Например, семантические роли и падежная грамматика являются примерами предикатов.

Теперь мы можем понять, что смысловое представление показывает, как собрать строительные блоки семантических систем. Другими словами, он показывает, как собрать сущности, концепции, отношения и предикаты для описания ситуации. Это также позволяет рассуждать о семантическом мире.

Подходы к смысловым представлениям

Семантический анализ использует следующие подходы для представления значения —

-

Логика предикатов первого порядка (FOPL)

-

Семантические сети

-

Рамки

-

Концептуальная зависимость (CD)

-

Архитектура на основе правил

-

Падеж грамматика

-

Концептуальные Графики

Логика предикатов первого порядка (FOPL)

Семантические сети

Рамки

Концептуальная зависимость (CD)

Архитектура на основе правил

Падеж грамматика

Концептуальные Графики

Необходимость смысловых представлений

Возникающий здесь вопрос: зачем нам нужен смысл представления? Ниже приведены причины того же —

Связывание лингвистических элементов с неязыковыми элементами

Самая первая причина заключается в том, что с помощью смыслового представления можно связать лингвистические элементы с неязыковыми.

Представляя разнообразие на лексическом уровне

С помощью смысловой репрезентации однозначные канонические формы могут быть представлены на лексическом уровне.

Можно использовать для рассуждений

Значение представления может быть использовано для обоснования проверки того, что является истинным в мире, а также для вывода знаний из семантического представления.

Лексическая семантика

Первая часть семантического анализа, изучающая значение отдельных слов, называется лексической семантикой. Он включает в себя слова, подслов, аффиксы (подразделы), составные слова и фразы, а также. Все слова, подслов и т. Д. В совокупности называются лексическими единицами. Другими словами, мы можем сказать, что лексическая семантика — это связь между лексическими элементами, значением предложений и синтаксисом предложения.

Ниже приведены шаги, включенные в лексическую семантику:

-

Классификация лексических элементов, таких как слова, подслов, аффиксы и т. Д., Выполняется в лексической семантике.

-

Разложение лексических элементов, таких как слова, подслов, аффиксы и т. Д., Выполняется в лексической семантике.

-

Различия, а также сходства между различными лексическими семантическими структурами также анализируются.

Классификация лексических элементов, таких как слова, подслов, аффиксы и т. Д., Выполняется в лексической семантике.

Разложение лексических элементов, таких как слова, подслов, аффиксы и т. Д., Выполняется в лексической семантике.

Различия, а также сходства между различными лексическими семантическими структурами также анализируются.

НЛП — однозначный смысл слова

Мы понимаем, что слова имеют разные значения в зависимости от контекста их использования в предложении. Если мы говорим о человеческих языках, то они также неоднозначны, потому что многие слова могут интерпретироваться различными способами в зависимости от контекста их возникновения.

Устранение неоднозначности смысла слова в обработке естественного языка (NLP) может быть определено как способность определять, какое значение слова активируется при использовании слова в определенном контексте. Лексическая неоднозначность, синтаксическая или семантическая, является одной из самых первых проблем, с которыми сталкивается любая система НЛП. Тэгеры части речи (POS) с высоким уровнем точности могут решить синтаксическую неоднозначность Word. С другой стороны, проблема разрешения семантической неоднозначности называется WSD (неоднозначность смысла слова). Разрешить семантическую неоднозначность сложнее, чем разрешить синтаксическую двусмысленность.

Например, рассмотрим два примера особого смысла, которые существуют для слова «бас» —

-

Я слышу звук баса.

-

Он любит есть на гриле бас.

Я слышу звук баса.

Он любит есть на гриле бас.

Появление слова « бас» явно обозначает четкое значение. В первом предложении это означает частоту, а во втором — рыба . Следовательно, если это будет устранено неоднозначностью WSD, то правильное значение для вышеупомянутых предложений может быть назначено следующим образом:

-

Я слышу бас / частоту звука.

-

Он любит есть на гриле окунь / рыбу.

Я слышу бас / частоту звука.

Он любит есть на гриле окунь / рыбу.

Оценка WSD

Оценка WSD требует следующих двух входов —

Словарь

Самым первым входом для оценки WSD является словарь, который используется для определения чувств, которые необходимо устранить.

Тестовый корпус

Другой вход, требуемый WSD, — это аннотированный тестовый корпус, имеющий целевой или правильный смысл. Тестовые корпуса могут быть двух типов & minsu;

-

Лексический образец — этот вид корпусов используется в системе, где требуется устранить неоднозначность небольшой выборки слов.

-

Все слова — этот тип корпусов используется в системе, где предполагается, что все слова будут неоднозначными в бегущем тексте.

Лексический образец — этот вид корпусов используется в системе, где требуется устранить неоднозначность небольшой выборки слов.

Все слова — этот тип корпусов используется в системе, где предполагается, что все слова будут неоднозначными в бегущем тексте.

Подходы и методы устранения неоднозначности в смысле слова (WSD)

Подходы и методы к WSD классифицируются в соответствии с источником знаний, используемых в устранении неоднозначности слов.

Давайте теперь посмотрим на четыре традиционных метода WSD —

Методы на основе словаря или знаний

Как следует из названия, для устранения неоднозначности эти методы в первую очередь опираются на словари, сокровища и лексическую базу знаний. Они не используют телесные доказательства для устранения неоднозначности. Метод Lesk — это основанный на словаре метод, основанный на словарях в 1986 году. В основу определения Lesk, лежащего в основе алгоритма Lesk, входит «измерение перекрытия между определениями смыслов для всех слов в контексте» . Однако в 2000 году Килгаррифф и Розенцвейг дали упрощенное определение Леска как «измерение совпадения между определениями смысла слова и текущим контекстом» , что дополнительно означает определение правильного смысла для одного слова за раз. Здесь текущий контекст — это набор слов в окружающем предложении или абзаце.

Контролируемые методы

Для устранения неоднозначности, методы машинного обучения используют аннотированный корпус для обучения. Эти методы предполагают, что контекст сам по себе может предоставить достаточно доказательств для устранения неоднозначности смысла. В этих методах слова знание и рассуждение считаются ненужными. Контекст представлен в виде набора «свойств» слов. Он также включает в себя информацию об окружающих словах. Механизм опорных векторов и обучение на основе памяти являются наиболее успешными контролируемыми подходами к WSD. Эти методы основаны на значительном количестве корпусов, помеченных вручную, что очень дорого создавать.

Методы под наблюдением

Из-за отсутствия учебного корпуса в большинстве алгоритмов устранения неоднозначности смысла слова используются методы обучения с полууправляемым обучением. Это связано с тем, что в полууправляемых методах используются как помеченные, так и непомеченные данные. Эти методы требуют очень небольшого количества аннотированного текста и большого количества простого аннотированного текста. Техника, которая используется в методах полуобслуживания, является начальной загрузкой из начальных данных.

Неконтролируемые методы

Эти методы предполагают, что подобные чувства встречаются в сходном контексте. Вот почему чувства могут быть выведены из текста путем кластеризации вхождений слов с использованием некоторой меры сходства контекста. Эта задача называется индукцией смысла слова или различением. Неконтролируемые методы имеют большой потенциал для преодоления узкого места приобретения знаний из-за отсутствия зависимости от ручных усилий.

Применение неоднозначности смысла слова (WSD)

Смысл словосочетания (WSD) применяется практически в каждом приложении языковой технологии.

Давайте теперь посмотрим на сферу WSD —

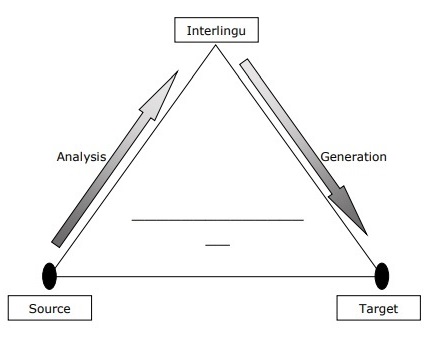

Машинный перевод

Машинный перевод или MT является наиболее очевидным применением WSD. В МТ лексический выбор слов, имеющих разные переводы для разных смыслов, осуществляется WSD. Чувства в МТ представляются в виде слов на целевом языке. Большинство систем машинного перевода не используют явный модуль WSD.

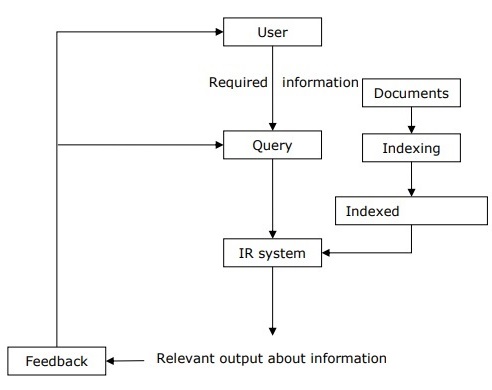

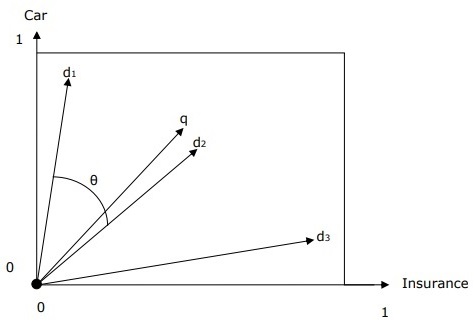

Информационный поиск (IR)

Поиск информации (IR) может быть определен как программное обеспечение, которое занимается организацией, хранением, поиском и оценкой информации из хранилищ документов, в частности текстовой информации. Система в основном помогает пользователям в поиске необходимой информации, но не дает явных ответов на вопросы. WSD используется для разрешения неоднозначностей запросов, предоставляемых IR-системе. Как и MT, современные IR-системы явно не используют модуль WSD, и они полагаются на концепцию, согласно которой пользователь будет набирать в запросе достаточно контекста, чтобы получать только соответствующие документы.

Добыча текста и извлечение информации (IE)

В большинстве приложений WSD необходим для точного анализа текста. Например, WSD помогает интеллектуальной системе сбора данных пометить правильные слова. Например, медицинской интеллектуальной системе может потребоваться пометка «незаконных наркотиков», а не «медицинских препаратов»

Лексикография

WSD и лексикография могут работать в цикле, потому что современная лексикография основана на корпусе. С помощью лексикографии WSD обеспечивает грубые эмпирические смысловые группировки, а также статистически значимые контекстные показатели смысла.

Трудности в устранении неоднозначности смысла слова (WSD)

Ниже приведены некоторые трудности, с которыми сталкиваются двусмысленности в смысле слова (WSD) —

Различия между словарями

Основная проблема WSD состоит в том, чтобы определить смысл слова, потому что разные чувства могут быть очень тесно связаны. Даже разные словари и тезаурусы могут обеспечить разное деление слов на смыслы.

Разные алгоритмы для разных приложений

Другая проблема WSD заключается в том, что для разных приложений может потребоваться совершенно другой алгоритм. Например, в машинном переводе это принимает форму выбора целевого слова; и при поиске информации инвентаризация смысла не требуется.

Расхождение между судьями

Другая проблема WSD состоит в том, что системы WSD, как правило, тестируются, сравнивая результаты своих задач с задачами людей. Это называется проблемой межсудовой дисперсии.

Слово-смысловая дискретность

Другая трудность в WSD состоит в том, что слова не могут быть легко разделены на отдельные значения.

Обработка дискурса естественного языка

Самая сложная проблема ИИ — это обработка естественного языка с помощью компьютеров, или, другими словами, обработка естественного языка является самой сложной проблемой искусственного интеллекта. Если мы говорим об основных проблемах в НЛП, то одной из основных проблем в НЛП является обработка дискурса — построение теорий и моделей того, как высказывания слипаются, образуя согласованный дискурс . На самом деле, язык всегда состоит из связанных, структурированных и связных групп предложений, а не изолированных и не связанных предложений, таких как фильмы. Эти согласованные группы предложений упоминаются как дискурс.

Концепция когерентности

Согласованность и структура дискурса во многом взаимосвязаны. Связность, наряду со свойством хорошего текста, используется для оценки качества вывода системы генерации естественного языка. Возникающий здесь вопрос: что означает, что текст является связным? Предположим, мы собрали одно предложение на каждой странице газеты, тогда это будет дискурс? Конечно, нет. Это потому, что эти предложения не показывают последовательность. Когерентный дискурс должен обладать следующими свойствами —

Соотношение когерентности между высказываниями

Дискурс был бы последовательным, если бы он имел значимые связи между своими высказываниями. Это свойство называется отношением когерентности. Например, должно быть какое-то объяснение, чтобы оправдать связь между высказываниями.

Отношения между сущностями

Другое свойство, которое делает дискурс связным, заключается в том, что должны быть определенные виды отношений с сущностями. Такой вид последовательности называется когерентностью на основе сущностей.

Структура дискурса

Важный вопрос, касающийся дискурса, заключается в том, какую структуру должен иметь дискурс. Ответ на этот вопрос зависит от сегментации, которую мы применили к дискурсу. Сегментации дискурса могут быть определены как определяющие типы структур для большого дискурса. Реализовать дискурсивную сегментацию довольно сложно, но это очень важно для приложений поиска информации, суммирования текста и извлечения информации .

Алгоритмы дискурсивной сегментации

В этом разделе мы узнаем об алгоритмах сегментации дискурса. Алгоритмы описаны ниже —

Сегментация дискурса без присмотра

Класс сегментации дискурса без присмотра часто представлен как линейная сегментация. Мы можем понять задачу линейной сегментации на примере. В этом примере задача разбить текст на несколько абзацев; единицы представляют собой прохождение исходного текста. Эти алгоритмы зависят от сплоченности, которая может быть определена как использование определенных лингвистических устройств для связывания текстовых единиц вместе. С другой стороны, сплоченность лексики — это сплоченность, на которую указывают отношения между двумя или более словами в двух единицах, например использование синонимов.

Сегментация контролируемого дискурса

Предыдущий метод не имеет каких-либо помеченных вручную границ сегментов. С другой стороны, сегментация контролируемого дискурса должна иметь обучающие данные с маркировкой границ. Это очень легко приобрести то же самое. В контролируемой сегментации дискурса важную роль играют дискурсивный маркер или ключевые слова. Маркер дискурса или ключевое слово — это слово или фраза, которые функционируют для обозначения структуры дискурса. Эти дискурсивные маркеры являются предметно-ориентированными.

Согласованность текста

Лексическое повторение — это способ найти структуру в дискурсе, но оно не удовлетворяет требованию быть последовательным дискурсом. Чтобы достигнуть связного дискурса, мы должны сосредоточиться на связности отношений в частности. Как известно, отношение когерентности определяет возможную связь между высказываниями в дискурсе. Хебб предложил такие отношения следующим образом:

Мы берем два термина S 0 и S 1, чтобы представить значение двух связанных предложений:

Результат

Из этого следует, что состояние, утверждаемое термином S 0, может вызвать состояние, утверждаемое S 1 . Например, два утверждения показывают результат отношений: Рам был пойман в огне. Его кожа сгорела.

объяснение

Это означает, что состояние, утвержденное S 1, может вызвать состояние, утвержденное S 0 . Например, два утверждения показывают отношения — Рам сражался с другом Шьяма. Он был пьян.

Параллельно

Он выводит p (a1, a2,…) из утверждения S 0 и p (b1, b2,…) из утверждения S 1 . Здесь ai и bi одинаковы для всех i. Например, два утверждения параллельны — Рам хотел машину. Шиам хотел денег.

разработка

Он выводит одно и то же утверждение P из обоих утверждений — S 0 и S 1. Например, два утверждения показывают развитие отношения: Рам был из Чандигарха. Шиам был из Кералы.

Случай

Это происходит, когда изменение состояния может быть выведено из утверждения S 0 , конечное состояние которого может быть выведено из S 1 и наоборот. Например, два утверждения показывают случай отношения: Рам взял книгу. Он дал это Шиаму.

Построение иерархической структуры дискурса

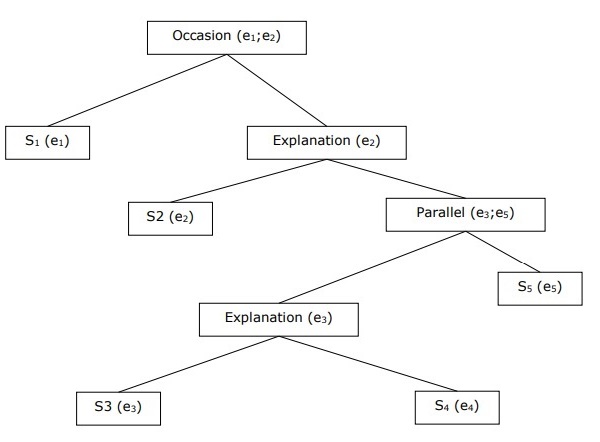

Когерентность всего дискурса может также рассматриваться иерархической структурой между отношениями когерентности. Например, следующий отрывок может быть представлен в виде иерархической структуры —

-

S 1 — Рам пошел в банк, чтобы внести деньги.

-

S 2 — Затем он сел на поезд до магазина одежды Шиама.

-

S 3 — Он хотел купить одежду.

-

S 4 — У него нет новой одежды для вечеринки.

-

S 5 — Он также хотел поговорить с Shyam относительно его здоровья

S 1 — Рам пошел в банк, чтобы внести деньги.

S 2 — Затем он сел на поезд до магазина одежды Шиама.

S 3 — Он хотел купить одежду.

S 4 — У него нет новой одежды для вечеринки.

S 5 — Он также хотел поговорить с Shyam относительно его здоровья

Справочное разрешение

Интерпретация предложений из любого дискурса является еще одной важной задачей, и для достижения этой цели нам необходимо знать, о ком или о каком объекте идет речь. Здесь ссылка на интерпретацию является ключевым элементом. Ссылка может быть определена как лингвистическое выражение для обозначения сущности или индивидуума. Например, в проходе Рам , менеджер банка ABC , увидел своего друга Шьяма в магазине. Он пошел ему навстречу, такие лингвистические выражения, как «Рам», «Его», «Он» — это ссылки.

В том же примечании эталонное разрешение может быть определено как задача определения того, на какие объекты ссылается какое языковое выражение.

Терминология, используемая в справочной резолюции

Мы используем следующие термины в справочной резолюции —

-

Ссылочное выражение — выражение на естественном языке, используемое для выполнения ссылки, называется ссылочным выражением. Например, отрывок, использованный выше, является ссылочным выражением.

-

Референт — это сущность, которая упоминается. Например, в последнем приведенном примере Рам является референтом.

-

Corefer — когда два выражения используются для ссылки на один и тот же объект, они называются corefers. Например, Рам и он — помощники.

-

Антецедент — Термин имеет лицензию на использование другого термина. Например, Рам является предшественником ссылки он .

-

Анафора и Анафор — это может быть определено как ссылка на сущность, которая была ранее введена в предложение. И, ссылающееся выражение называется анафорическим.

-

Модель дискурса — модель, которая содержит представления сущностей, которые упоминались в дискурсе, и отношения, в которых они участвуют.

Ссылочное выражение — выражение на естественном языке, используемое для выполнения ссылки, называется ссылочным выражением. Например, отрывок, использованный выше, является ссылочным выражением.

Референт — это сущность, которая упоминается. Например, в последнем приведенном примере Рам является референтом.

Corefer — когда два выражения используются для ссылки на один и тот же объект, они называются corefers. Например, Рам и он — помощники.

Антецедент — Термин имеет лицензию на использование другого термина. Например, Рам является предшественником ссылки он .

Анафора и Анафор — это может быть определено как ссылка на сущность, которая была ранее введена в предложение. И, ссылающееся выражение называется анафорическим.

Модель дискурса — модель, которая содержит представления сущностей, которые упоминались в дискурсе, и отношения, в которых они участвуют.

Типы ссылающихся выражений

Давайте теперь посмотрим на различные типы ссылочных выражений. Пять типов ссылочных выражений описаны ниже —

Неопределенные существительные фразы

Такой вид ссылки представляет объекты, которые являются новыми для слушателя в контексте дискурса. Например — в предложении Рама однажды ходил, чтобы принести ему немного еды, — какое-то неопределенное указание.

Определенные Фразы Существительных

В противоположность вышесказанному, такого рода ссылки представляют сущности, которые не являются новыми или не могут быть идентифицированы для слушателя в контексте разговора. Например, в предложении — я читал «Таймс оф Индия» — «Таймс оф Индия» — это определенная ссылка.

Местоимения

Это форма определенной ссылки. Например, Рам смеялся так громко, как мог. Слово, которое он представляет местоимение, ссылаясь на выражение.

Указательные местоимения

Они демонстрируют и ведут себя иначе, чем простые определенные местоимения. Например, это и то, что являются наглядными местоимениями.

имена

Это самый простой тип ссылочного выражения. Это может быть имя человека, организации и места также. Например, в приведенных выше примерах Ram является выражением, ссылающимся на имя.

Задачи справочного разрешения

Две контрольные задачи разрешения описаны ниже.

Разрешение Coreference

Задача состоит в том, чтобы найти ссылающиеся выражения в тексте, которые ссылаются на одну и ту же сущность. Проще говоря, это задача поиска выражений corefer. Набор выражений coreferring называется цепью coreference. Например — Он, Главный менеджер и Его — это ссылки на выражения в первом отрывке, приведенном в качестве примера.

Ограничение на разрешение контрольных точек

В английском языке основной проблемой разрешения ключевых слов является местоимение it. Причина этого в том, что местоимение у него много употреблений. Например, это может относиться так же, как он и она. Местоимение также относится к вещам, которые не относятся к конкретным вещам. Например, идет дождь. Это действительно хорошо.

Прономинальное разрешение анафоры

В отличие от разрешения по основным признакам, местоименное разрешение анафоры может быть определено как задача поиска антецедента для одного местоимения. Например, местоимение принадлежит ему, и задача разрешения местоименной анафоры состоит в том, чтобы найти слово Ram, потому что Ram является предшественником.

Пометка части речи (PoS)

Маркировка — это разновидность классификации, которая может быть определена как автоматическое присвоение описания токенам. Здесь дескриптор называется тегом, который может представлять одну из частей речи, семантическую информацию и так далее.

Теперь, если мы говорим о тегировании части речи (PoS), то это может быть определено как процесс присвоения одной из частей речи данному слову. Обычно это маркировка POS. Проще говоря, мы можем сказать, что POS-теги — это задача маркировки каждого слова в предложении соответствующей частью речи. Мы уже знаем, что части речи включают в себя существительные, глаголы, наречия, прилагательные, местоимения, союз и их подкатегории.

Большая часть POS-тегов относится к POS-тегам на основе правил, Stochastic POS-тегам и тегам на основе преобразования.

POS-теги на основе правил

Одним из самых старых методов тегирования является POS-тегирование на основе правил. Основанные на правилах тегеры используют словарь или лексику для получения возможных тегов для маркировки каждого слова. Если слово имеет более одного возможного тега, то тегеры на основе правил используют рукописные правила для определения правильного тега. Устранение неоднозначности также может быть выполнено в тегировании на основе правил путем анализа лингвистических особенностей слова наряду с предшествующими, а также последующими словами. Например, предположим, что если предыдущим словом слова является артикль, тогда слово должно быть существительным.

Как следует из названия, вся такая информация в тегах POS на основе правил кодируется в форме правил. Эти правила могут быть:

-

Правила контекстного шаблона

-

Или, как регулярное выражение, скомпилированное в конечные автоматы, пересекается с лексически неоднозначным представлением предложения.

Правила контекстного шаблона

Или, как регулярное выражение, скомпилированное в конечные автоматы, пересекается с лексически неоднозначным представлением предложения.

Мы также можем понять POS-теги на основе правил по их двухэтапной архитектуре —

-

Первый этап — На первом этапе он использует словарь, чтобы назначить каждому слову список потенциальных частей речи.

-

Второй этап. На втором этапе используются большие списки рукописных правил устранения неоднозначности, чтобы отсортировать список по одной части речи для каждого слова.

Первый этап — На первом этапе он использует словарь, чтобы назначить каждому слову список потенциальных частей речи.

Второй этап. На втором этапе используются большие списки рукописных правил устранения неоднозначности, чтобы отсортировать список по одной части речи для каждого слова.

Свойства POS-тегов на основе правил

POS-теги на основе правил обладают следующими свойствами:

-

Эти тегеры являются тегерами, основанными на знаниях.

-

Правила в POS-тегах на основе правил создаются вручную.

-

Информация закодирована в виде правил.

-